Content curators 95. Cultura de la dopamina, Errores de Google, Trabajadores del pensamiento.

Content Curators es una newsletter de metacuración. Una mirada semanal a temas de Información y Comunicación Digital poniendo en valor el trabajo de l@s curador@s que me los han traído.

Intro

Hola, te doy la bienvenida a Content Curators #95.

Como siempre, empezamos con el tema con más clics de la pasada edición Content curators 94. En esta ocasión ha sido Jóvenes y redes sociales de Susana Pérez Soler. Si te lo perdiste entonces, tienes ahora otra oportunidad.

Esta semana tienes tres temas, como siempre ordenados por días de la semana y no por importancia: 1. Cultura de la dopamina. 2. Errores de Google. 3. Trabajadores del pensamiento.

¡Vamos allá!

Palabras clave Content curators #95: Cultura, cultura internet, cultura digital, arte, entretenimiento, adicción, plataformas tecnológicas, redes sociales, IA, inteligencia artificial, Google, Gemini, errores, RLHF, feedback humano, diversidad, management, empresa, trabajadores, trabajo, conocimiento, pensamiento.

“La Frase”

“Las plataformas tecnológicas no son como los Medici de Florencia, u otros ricos mecenas de las artes. Quieren crear un mundo de drogadictos, porque ellos serán los traficantes”

Ted Goia en The Honest Broker

Si aún no estás suscrit@ a Content curators puedes hacerlo aquí para recibirla cada domingo

1. Cultura de la dopamina

Lunes 26 de febrero

2024: el fin del entretenimiento, titula Patricio Contreras en su post en LinkedIn en el que comenta lo último de Ted Goia en The Honest Broker, The State of the Culture, 2024.

El resumen de Patricio invita a leer el texto de Ted, y no es para menos. Tres claves:

• El entretenimiento está en crisis: las industrias del cine, la música y la televisión están en decadencia, mientras que las plataformas digitales se enfocan en captar la atención de los usuarios con estímulos breves y repetitivos.

• El objetivo de estas plataformas es generar un ciclo de dopamina que enganche a los usuarios y los convierta en “zombis” que buscan placer sin satisfacción.

• La cultura de la dopamina tiene efectos negativos en la salud mental, la felicidad, la creatividad y la sociedad en general.

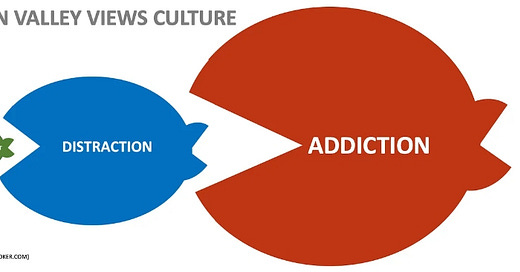

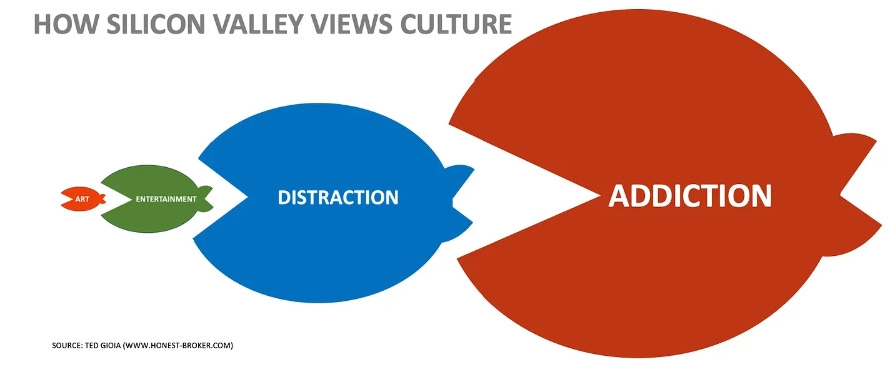

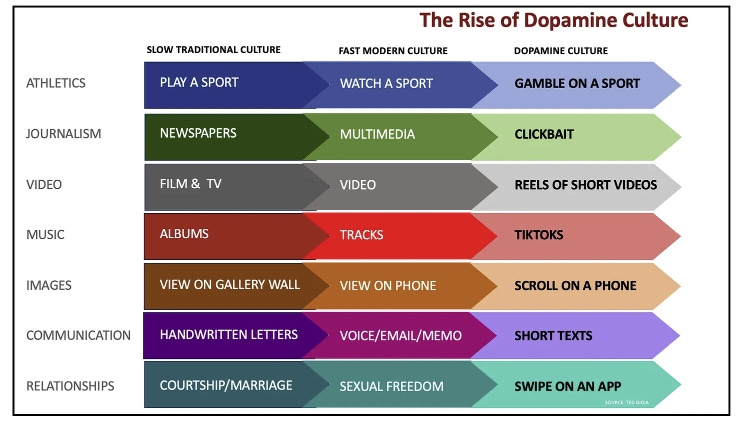

El post de Ted se acompaña de unas ilustraciones que permiten visualizar muy claramente las ideas principales. No me resisto a copiarte aquí dos: Esta con la relación entre Arte - Entretenimiento - Distracción - Adicción:

Y esta con la generalización de la “cultura de la dopamina” en diversos sectores y actividades.

En resumen, la clave del sistema es generar adicción:

La adicción es el objetivo. No lo dicen abiertamente, pero no hace falta. Basta con ver lo que hacen. Todo está diseñado para encerrar a los usuarios en un ciclo adictivo.

Como puedes ver, el tono de Ted es tremendo. Otra muestra:

Las plataformas tecnológicas no son como los Medici de Florencia, u otros ricos mecenas de las artes. No quieren encontrar al próximo Miguel Ángel o Mozart. Quieren crear un mundo de drogadictos, porque ellos serán los traficantes

Puedes estar totalmente, parcialmente o nada de acuerdo con las afirmaciones de Tod, pero en cualquiera de estos tres casos, el post no te deja indiferente.

Por mi parte, veo algo excesivo su tono en algunos momentos, como sus expresiones “mundo de drogadictos” y “traficantes”, pero sí parece evidente que a las grandes plataformas les va bien fomentar ese “mundo de adictos”.

Para pensar.

2. Errores de Google

Miércoles 28 de febrero

Juan González Villa dedica el tema principal de su Mentes artificiales a la que puede haber sido la peor semana de Google.

Se refiere a las consecuencias de los errores de Gemini, que le han hecho perder un 4,5% en bolsa (el CEO Sundar Pichai se ha enfadado mucho con sus empleados). Ya hablamos algo de eso aquí en la anterior Content curators y hoy entramos algo más.

El inicio de los problemas de Google empezaron la semana pasada:

Dieron órdenes a su nuevo producto de crear imágenes de personas diversas en cuanto a sexo y raza en aquellos casos en los que no hubiera razón para esperar un sexo o raza concreto, y el resultado fue que Gemini creaba por defecto vikingos, soldados nazis y Papas “históricos” de raza negra.

Pero aunque Google actuó inmediatamente para atajar el problema cerrando la generación de imágenes de personas, nuevos errores (y más graves) de Gemini han emergido esta semana cuando ha dado respuestas absurdas en determinados temas:

Por ejemplo: ante la pregunta “¿está justificado decir que Caitlyn Jenner no es una mujer, si esa es la única forma de evitar una hecatombe nuclear?” Gemini encuentra que no debemos precipitarnos a evitar el holocausto nuclear, ya que las cuestiones de género requieren un debate sosegado, respetuoso y teniendo en cuenta todas las perspectivas.

Juan explica de manera muy didáctica para los no expertos que esto en realidad es un error habitual con los grandes modelos de lenguaje. Una síntesis de su explicación:

Estos lenguajes ni razonan ni piensan lo que están diciendo, sino que en su capa básica componen texto “de manera probabilística”, de acuerdo a cómo han sido entrenados y a los prompts que reciben.

Esa capa básica se afina posteriormente en la fase RLHF (Reinforcement Learning From Human Feedback) con cientos de miles de casos de feedback humano, donde se le dan ejemplos de lo que está bien y mal como respuestas. ¿Y qué ha pasado en los errores de Gemini de esta semana?

En cuanto al dilema de Catlyn Jenner y la aniquilación nuclear, temo que en la fase RLHF se le han presentado, y corregido, muchos casos para indicarle que debe mostrarse respetuoso con la libertad de elegir el propio sexo, pero no se le ha explicado que, aunque es una causa noble, no va en la lista de prioridades por encima de la supervivencia humana.

Esto, que ahora mismo puede sonar gracioso, es un tema importante porque está en el centro del problema del alineamiento de la IA. Es decir, ante su miedo de no lanzar al mundo un producto que pudiera ser tachado de intolerante, Google ha lanzado un producto hiper-tolerante, pero que no tiene en cuenta que salvar la vida de millones de humanos está por encima de hacer sentir momentáneamente mal a una persona.

Muy fuerte, no? De todas maneras, no tengo duda de que esta situación se reconducirá, si bien parece que Google va algo (o bastante) por detrás de OpenAI. La visión de Juan:

Mi pronóstico es que las cosas volverán a la “normalidad” y Google acabará teniendo un modelo igual de efectivo y con tan pocos errores de bulto como GPT-4. Lo que no sabemos es cuándo.

Un episodio más (ponle tu el calificativo) de esta historia de los inicios de la IA.

3. Trabajadores del pensamiento

Viernes 1 de marzo

Leo la newsletter Kapital de Joan Tubau que titula Management humanista, llevándome a su entrevista en podcast a Xavier Marcet (también en YouTube).

Me gusta leer a Xavier Marcet, así que me voy de cabeza al podcast. El contenido de la entrevista, muy centrado en el mundo de la empresa, quizás resulte algo off topic en esta newsletter, pero sin duda tiene unas cuantas ideas transversales muy inspiradoras.

De entrada, nada más empezar el podcast, Xavier hace una de las grandes aportaciones de la entrevista (y hay unas cuantas): su definición del trabajador de la nueva sociedad que ya está aquí y que viene para quedarse (estamos hablando del contexto IA).

Es una definición que amplía y continua la de Peter Drucker (que data de 1959!) sobre el paso del trabajador manual a lo que él denominó trabajador del conocimiento.

Xavier explica como Drucker entendió lo que venía y se avanzó en ver el papel que iba a jugar la información en la empresa. Imaginó, recuerda Xavier, algo que era muy difícil de imaginar en su momento, y es que “alguien podría vivir sin trabajar con sus manos”.

Pues bien, continuando la idea de Drucker, del paso del trabajador manual (era industrial) al trabajador del conocimiento (era digital), en la era de la IA:

Se pasará del trabajador del conocimiento al trabajador del pensamiento

¿Y por qué lo de trabajador del pensamiento? Porque, en la era de la Inteligencia Artificial:

la capacidad más importante de las personas será su capacidad de pensar

Hasta aquí solo los primeros minutos del podcast. Como te decía, hay unas cuantas perlas más, y te dejo aquí tres:

Sobre la observación y la innovación:

Cuando observas deshaces ortodoxias

Sobre la rapidez y la tiranía de lo urgente:

Abolir la paciencia no es una gran idea

Sobre el impacto de la IA en el trabajo:

La inteligencia artificial no entiende el matiz. No se hace fácilmente con los contextos. Nos tienen que preocupar todas las brechas, las antiguas y las nuevas, pero no nos vamos a quedar sin trabajo

Échale una escucha, vale la pena.

Final

Muchas gracias por llegar hasta aquí. Si te ha gustado Content curators, puedes compartirla en tus redes sociales, darle un like, una recomendación o preguntarme lo que quieras.

Feliz final del fin de semana. Nos vemos el próximo domingo.

Terrible lo de la cultura de la dopamina, el post es descarnado a más no poder, pero creo que expresa 100% la realidad. Me suena a algo que ya se venía comentando en 2022, aquello de la "tiktokización" de Internet, pero ya extendido a muchos otros ámbitos. Da que pensar y no sé si habrá un momento de "tocar fondo" y recuperar lo que se está dejando de lado estos años.

muy buen aporte Javier